平板摄像头+算力搞定3D空间实时重建和理解,清华和禾多科技新成果入选CVPR 2022 Oral

无人车机器人都能用

明敏 发自 凹非寺

量子位 | 公众号 QbitAI

仅仅需要一个平板电脑,就能实现3D空间的实时重建和理解了!

看,只要拿着平板电脑走一走,房间内的物体就能被实时重建、分割和识别出来,整个过程行云流水。

要知道,3D重建和语义理解,是机器人、自动驾驶、AR/VR等领域的关键共性技术,长期以来面临算法复杂度高,难以实时处理的挑战。

现在,只用一个小小的平板就搞定了。

这就是清华大学联合禾多科技提出的增量式稀疏卷积网络(INcremental Sparse Convolution,INS-Conv)。

在不损失性能的同时,极大地降低了算法的复杂度。

目前,该论文已被CVPR 2022(Oral)收录。

那么具体是怎么做的呢?

增量式稀疏卷积网络

本论文的核心之处,是提出了一种增量式稀疏卷积神经网络(INcremental Sparse Convolution,INS-Conv)。

算法复杂、推理速度慢、算力要求高是长期以来,3D语义理解算法在应用场景中面临的核心挑战。

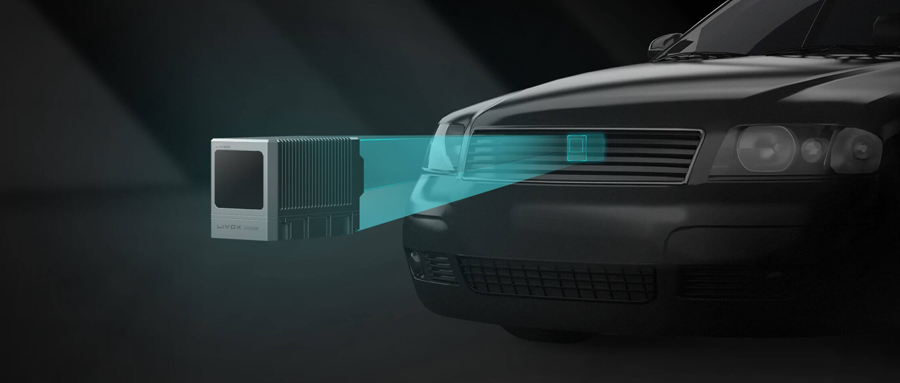

比如自动驾驶场景,就要求三维感知系统能够对快速变化的路况做出实时判断,而且要精确识别车辆、行人、路标等。

尽管过去很多密集3D卷积网络在精度上取得了不错成绩,但是对芯片算力的要求也随之增高,网络推理速度上也不够快,往往是几秒钟才能处理一帧信息,难以满足如自动驾驶等应用的需求。

所以,研究人员提出了一种增量稀疏卷积神经网络,专门针对连续帧的残差进行增量推理。

简单来说,就是一段递增的3D几何序列可以表示为:

那么,在 t 时间点下的表示为:

其中,dx表示时间t和t-1之间的残差,t-1时刻的数据是之前已经缓存的,因此只需计算f(dx)。

由于dx在这里是非常稀疏的,因此计算量会大幅减少。

也就是说,在这个神经网络中,为稀疏卷积操作定义了全新的残差传播规则,用INS-Conv层替换标准稀疏卷积网络层,就能以最小的精度损失实现高效的增量推理。

在ScanNetv2验证集上,2个不同时间点下,INS-Conv语义分割和实例分割的效果如下。

和其他方法对比,在ScanNetv2数据集中,语义分割任务下INS-Conv的均交并比(mIoU)结果优于其他两种实时方法。

实例分割任务下,INS-Conv达到了现有离线算法的性能,与现有的在线算法相比,性能提升可达10%。

现在越来越多的车上除了摄像头之外开始装配有激光雷达,通过论文中描述的方法能够更快更好地进行三维重建、场景理解等三维感知任务,从而更好地为自动驾驶系统的全面安全保驾护航。

团队介绍

论文的第一单位为清华大学成像与智能技术实验室,通讯作者为清华大学电子工程系副教授方璐。

成像与智能技术实验室致力于计算成像和视觉智能领域的跨学科研究,主要包括光场智能成像,光场重建、分析与理解,新一代光电智能计算架构与芯片等。

发表Nature Photonics(封面文章), Light: Science & Applications(封面文章), Nature Methods, Nature Machine Intelligence,IEEE TPAMI, CVPR等文章。

这次论文合作者中,还有禾多科技创始人、CEO倪凯博士。

倪凯本科毕业于清华大学,后赴佐治亚理工学院攻读博士学位,在IEEE/IROS/ICRA等计算机顶会上发表学术论文十余篇,曾任职于微软和百度。

2017年,倪凯宣布创立自动驾驶领域公司禾多科技。

据了解,禾多科技正在打造由本地数据驱动的自动驾驶量产解决方案。

两大核心方案为HoloPilot行车自动驾驶系统和HoloParking智能泊车系统。

今年3月,禾多科技宣布完成数亿元战略融资轮,由广汽资本独家投资。

按照计划,搭载禾多科技自动驾驶系统的多款广汽车型将于2022年开始陆续上市。

学术研究方面,禾多科技与清华大学、武汉大学、加州伯克利大学、佐治亚理工学院都达成了学术合作。

传送门

INS-Conv代码已在GitHub开源,欢迎下载使用(包括实验室其他开源项目):

https://thu-luvision.github.io/Large_scale_reconstruction/RGBD/insconv.html

参考链接:

https://www.youtube.com/watch?v=V4gVuNyKaPQ

- 智平方郭彦东:具身智能产业化成败在”物理世界大模型”工程化能力2024-12-26

- 业界首次!一个端到端原生机器人大模型搞定100+灵巧手复杂操作2024-12-26

- Ilya宣判后GPT-5被曝屡训屡败,一次训数月,数据要人工从头构建2024-12-22

- Sora开服被挤爆!支持中文/编剧模式/作品分享,145块就能玩2024-12-10