谷歌大脑研究员指明GAN研究方向:7大问题全面梳理,附赠研究建议

希望通过这七个问题,能向大家阐明他对于GAN这个研究课题的看法。

鱼羊 发自 纽凹非寺

量子位 报道 | 公众号 QbitAI

比起自己埋头写论文,聊聊自己感兴趣的方向,期待一下旁人的智慧,或许也是个不错的主意。

谷歌大脑研究员Augustus Odena最近有了新的想法,不是再写一篇GAN方面的论文,而是推荐几个他感兴趣的研究方向,看看别人在这些主题上都能写出什么样精彩的文章。

Augustus Odena是谷歌大脑机器学习方面的专家,2016年他开始发表生成对抗网络(GAN)领域的论文,不仅跟GANs之父Goodfellow有过密切的合作,其关于GAN的论文也频频登上机器学习国际顶会的舞台,可谓是GAN这一研究领域的一线大牛。

就在近日,大牛在distill上发表了一篇新的文章,没讲什么新研究,只是提出了关于GAN的七个问题。

大牛希望通过这七个问题,能向大家阐明他对于GAN这个研究课题的看法。而对于研究人员来说,大牛指路,简直就是把灵感源泉送到眼前,还不得赶紧多吸几口灵气?

七个问题,七种方向

问题1 GAN和其他生成模型之间的基本权衡是什么?

Problem 1 What are the trade-offs between GANs and other generative models?

问题2 GAN能为哪种分布建模?

Problem 2 What sorts of distributions can GANs model?

问题3 如何让GAN在非图像数据上表现良好?

Problem 3 How can we Scale GANs beyond image synthesis?

问题4 我们何时能够证明GAN是全局收敛的?

Problem 4 What can we say about the global convergence of the training dynamics?

问题5 我们该如何评估GAN,又该在何时使用它而非其他生成模型?

Problem 5 How should we evaluate GANs and when should we use them?

问题6 GAN训练如何按批大小进行扩展?

Problem 6 How does GAN training scale with batch size?

问题7 GAN与对抗样本之间的关系是什么?

Problem 7 What is the relationship between GANs and adversarial examples?

这些问题其实一直以来也是研究者们关心的重点,不过仅仅提出问题显然不是大牛的追求。Augustus Odena通过提问题的方式对GAN的研究背景进行了总结,同时也给出了一些解决问题的参考方向。

在Augustus Odena看来,GAN已经进入了一个发展的瓶颈期,现在是时候来梳理梳理这一研究领域的发展目标了。

来看看他都是如何总结的吧。

总结一:GAN是否会被取代

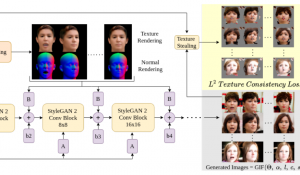

GAN并不等同于生成模型,但由于GAN在图像生成方面表现实在太突出,在网络上几乎成为了“网红”一般的存在。

但事实上,生成模型是研究的热点没错,GAN却并不是唯一的方向。GAN的提出者Goodfellow就说过,如果不能找到稳定训练GAN的方法,GAN有可能会被其他的结构取代。

Augustus Odena提到除了GAN以外,目前还有另外两种比较流行的生成模型:流模型和自回归模型。最近的研究成果表明,这些模型具有不同的性能特征和权衡。GAN并行高效但不可逆;流模型允许精确的对数似然计算和精确推理,但效率低;自回归模型可逆且高效,但不并行。

这也就带来了第一个问题:GAN和其他生成模型之间的基本权衡是什么?

Augustus Odena认为研究更多的模型能帮助解决这个问题,尤其是一些混合模型,比如混合GAN/流模型。他觉得在这个方向上还有很多值得发掘的东西。

总结二:用GAN给指定分布建模有多难

大多数GAN研究侧重于图像合成,人们往往都是用MINIST、CIFAR-10、STL-10、CelebA和Imagenet这样的数据集来训练GAN。而哪些数据集更容易建模,总有一些坊间传闻,但如果想要验证这些结论,那就复杂了。

Augustus Odena指出,与任何科学一样,GAN也希望有一个简单的理论来解释实验结果。 于是问题二就来了:我们怎么才能知道用GAN建模有多难?

大牛建议从两个方面着手:

合成数据集——通过研究合成数据集来探究哪些特征会影响学习性能

修改现有的理论结果——尝试修改现有理论结果的假设来解释数据集的不同属性

总结三:GAN只能合成图像吗

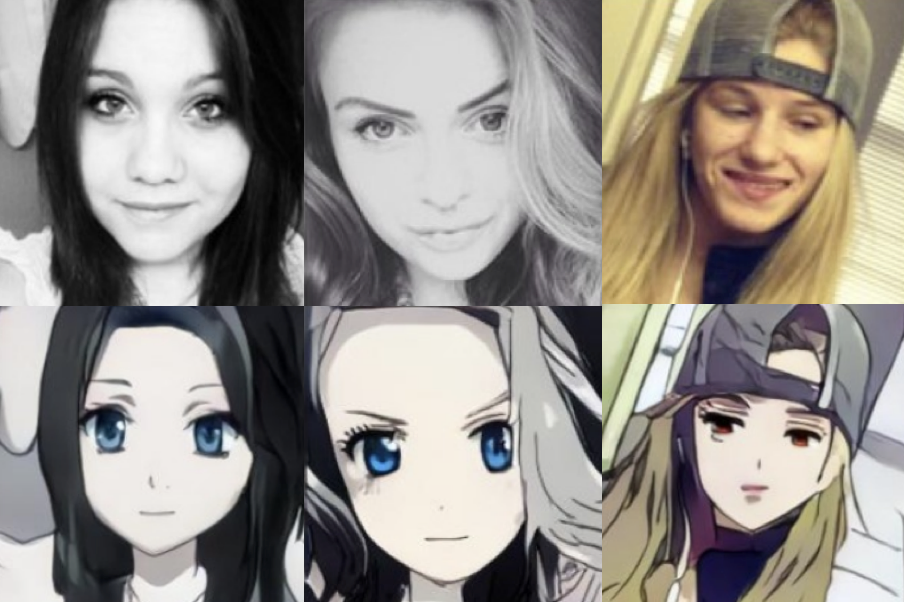

GAN在图像合成领域的成绩有目共睹,而在图像合成之外,Augustus Odena提到了三个主要受到关注的领域:文本,结构化数据,音频。

(快速生成高保真音频的新方法GANsynth, Jesse Engel, 2019)

在无监督音频合成方面GAN是比较成功的,但在其他方面还是乏善可陈。那么如何才能使GAN在非图像数据上表现得更好呢?这就是第三个问题。

是采取新的训练技术,还是从先验信息入手?大牛表示都不容易,这个问题的解决,也许得仰仗基础研究的进展了。

总结四:GAN的收敛问题

Augustus Odena还对GAN的收敛问题的研究进展进行了总结。

GAN的收敛问题一直备受关注。与其他神经网络不同,GAN的训练过程是在同时优化发生器和鉴别器,让两个AI相互对抗。模型不收敛的问题会使它变得不稳定。

大牛总结了三条技术路线,目前都有所突破,但都还没有研究完成。

简化假设——简化关于发生器和鉴别器的假设

使用正常神经网络技术——应用分析正常神经网络(非凸的)的技术来回答有关GAN收敛的问题

博弈论——用博弈论的概念对GAN训练进行建模

总结五:GAN的评估问题

关于GAN的评估,有很多提案但大多难成共识。这些建议包括:

- 初始分数和FID

- MS-SSIM

- AIS

- 几何分数

- 精确率和召回率

- 技能等级

这还只是GAN评估方案的一小部分,尽管初始分数和FID相对受欢迎,但GAN的评估显然不是一个一成不变的问题。

Augustus Odena认为如何评估GAN的困惑来源于对何时使用GAN的不解,于是他把两个问题捆绑在一起,先考虑GAN的适用性,再在这样的背景下去进行评估。

GAN很适合用来处理感知任务,它在图像合成、图像转换上的成绩已经证明了这一点。所以问题就变成了在感知任务的处理上我们如何评估GAN?

一个简便的方法就是分类器双样品测试(C2STs),这个方法的主要问题是,哪怕发生器只是产生了一个很小的缺陷,它都会主导评估结果。

大牛想了想,觉得这件事还是得由人来主导。为了降低成本,可以用机器来预测人类的判断结果,不过在预测结果不确定的时候,还是需要真人介入。

总结六:GAN训练如何按批大小进行扩展

大部分GAN中的鉴别器只是一个图像分类器,如果瓶颈在于梯度噪声,那么增加批大小就能加速训练。但是GAN有一个不同于分类器的瓶颈:它的训练过程是不稳定的。

Augustus Odena于是提出了第六个问题:GAN训练如何按批大小进行扩展?梯度噪声在GAN的训练过程中扮演什么样的角色?是否可以修改GAN训练,使其随批处理大小更好地实现扩展?

他指出了三个解决方案,其中,他认为在批大小非常大的时候,Optimal Transport GANs会是不错的选择。而异步SGD也是一个值得关注的方法。

总结七:鉴别器的对抗鲁棒性会如何影响GAN训练

众所周知,图像分类器会受到对抗样本的影响:对抗样本与真实样本的区别几乎无法用肉眼分辨,但是却会导致模型进行错误的判断。

由于GAN的鉴别器就是图像分类器,所以它也可能遭遇对抗样本的问题。

Augustus Odena提到,尽管有大量关于GAN和对抗样本的文献,但它们之间的关系却没有得到多少研究。

那么问题就来了:GAN和对抗样本之间有什么样的关系?鉴别器的对抗鲁棒性会如何影响GAN的训练结果?

Augustus Odena认为这个研究课题很有价值。对生成模型的蓄意攻击已经被证明是可行的,而遭到“意外攻击”的可能性虽然比较小,但也没有决定性的证据证明发生器不会产生对抗样本。

看完这些内容,你是否思路清晰了一些?总之,每一个问题都包含了大量的背景知识,听大牛讲那生成对抗网络的过去未来,总是没有坏处。

而大牛本人也表示,他很希望看到其他领域的研究者也能写写类似的文章,帮助大家梳理思路。

传送门

大牛文章:

https://distill.pub/2019/gan-open-problems/

- 脑机接口走向现实,11张PPT看懂中国脑机接口产业现状|量子位智库2021-08-10

- 张朝阳开课手推E=mc²,李永乐现场狂做笔记2022-03-11

- 阿里数学竞赛可以报名了!奖金增加到400万元,题目面向大众公开征集2022-03-14

- 英伟达遭黑客最后通牒:今天必须开源GPU驱动,否则公布1TB机密数据2022-03-05