微软一夜革新AI生产力,奥特曼剧透新模型!Copilot人人可定制,开发者狂喜

还有Phi-3多模态模型

编辑部 发自 凹非寺

量子位 | 公众号 QbitAI

今天,微软的生产力革命有了最新进展——

它正在将AI塞进所有可能找到的角落和缝隙。

除了在大会前一天就已剧透Copilot+PC,Build大会上微软还有超多释出成果:

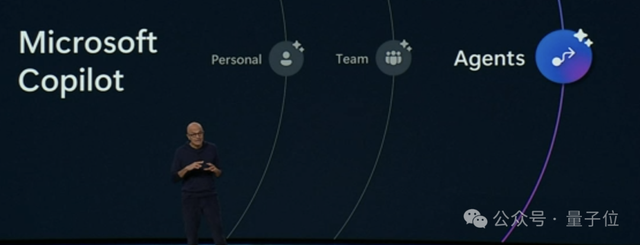

- Copilot持续升级:自定义Copilot、Team Copilot以及Copilot扩展等。总的来说,所有开发者都可以定制和扩展Copilot,而团队协同工作也更加方便。

- 将小模型进行到底,Phi-3能轻松在PC端、手机端运行,还有首个多模态模型Phi-3-vision。

还有这些细节更新,比如Microsoft Fabric的实时智能功能,能对实时、高精度的业务数据进行分析管理,帮助企业决策;Edge浏览器增加AI实时视频翻译功能;AI PC原生支持PyTorch……

开幕式上,纳德拉一上场就道明了今天这场大会的意义。

微软三十多年来有两个梦想,一个是计算机是否可以理解我们,而不是我们必须理解计算机?第二个是在这个信息不断增加的世界里,计算机能否帮助我们根据所有这些信息进行推理、规划和更有效地采取行动?

而这一波AI浪潮,就是微软梦想的答案。

Build大会展现的各种各样的生产力场景,也正是微软实现梦想的舞台。

开幕式尾声,奥特曼还站台亮相,回应和剧透了新模型的一切。

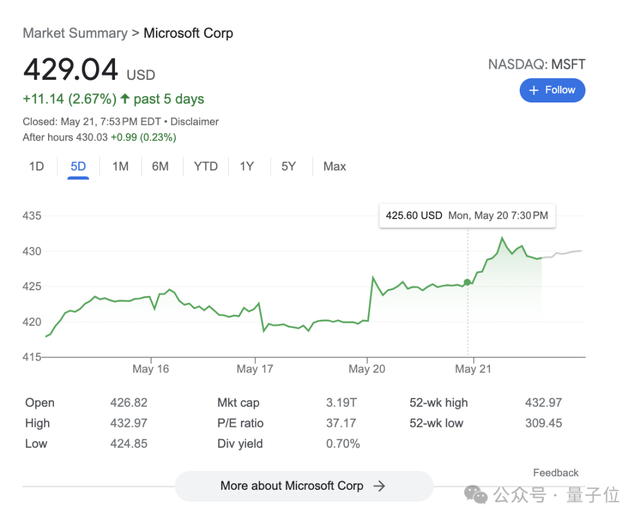

市场上微软股价也是一片向好,一度飙升到了431.84美元。该说不说,这两天微软都涨麻了。

咱先从Copilot持续升级说起。

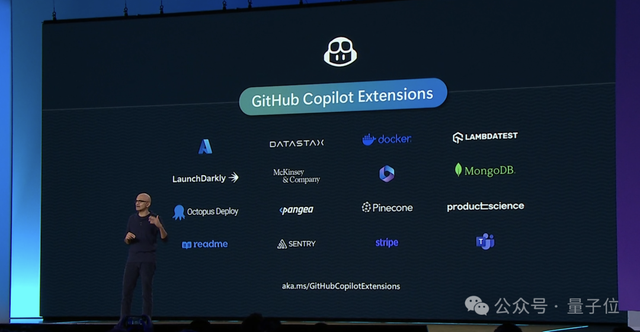

GitHub Copilot扩展:自然语言交互方方面面

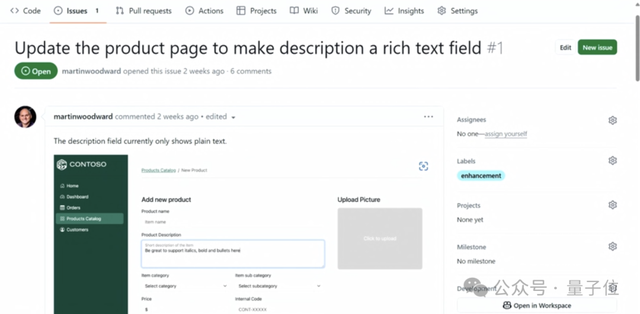

面向开发者和团队,微软推出GitHub Copilot扩展,可通过第三方服务功能用自然语言交互自定义GitHub Copilot体验。

可以立即部署到Azure,用语言交互即可获取管理Azure资源,比如向Azure询问Web应用程序的部署位置,一键排除故障查找相关代码:

任何开发者都可以为GitHub Copilot创建扩展,包括堆栈中的各种工具以及自己内部的工具。

打开Copilot WorkSpace,可以查看整个代码库,并提出修改建议。Copilot会自动根据定制进行修改:

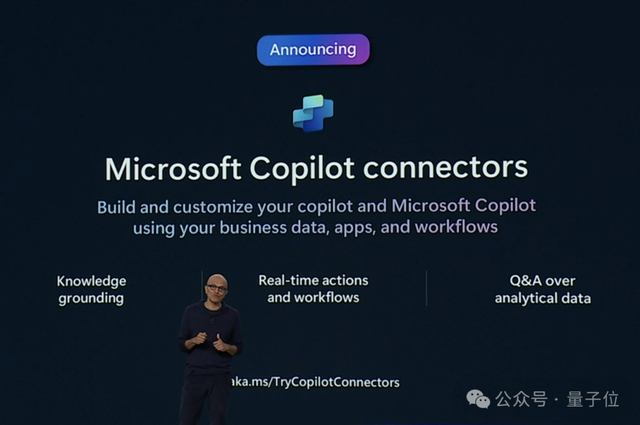

微软还推出了Copilot connectors,方便开发者用第三方业务数据、应用和工作流程定制Copilot。

Team Copilot:团队中的关键成员

除此之外,微软Copilot继续升级,推出Team Copilot,从此Copilot不仅是个人助手,更是可以变成团队中的一员。

可以把它拉到团队群里面,充当会议主持人,Copilot可以实时记录下会议中的全部内容:

根据团队讨论进度,一键整理主题、做笔记,同时支持群内其他人对其记录的内容进行修改:

讨论中遇到问题也可以直接向Copilot提问:

当团队成员就某一讨论达成一致观点,Copilot会一键实时更新之前的笔记内容:

Agent可以自定义

与此同时,微软Copilot Studio推出全新自定义Agent功能。

开发者可以自定义Agent职位,也可以从现成的模板里挑选:

开发者可以将权限委派给不同的角色的Copilot,自动化业务流程。Copilot在遇到不了解且无法处理的问题时,甚至会自动向你展示问题并寻求帮助。

此外,Agent还具备根据用户反馈进行学习等能力。

纳德拉现场表示:

我认为这是未来一年中真正能够带来变革的关键因素之一。

将小模型进行到底

除此之外,微软还更新了自己的模型——Phi-3,继续将小模型(SLM)进行到底。

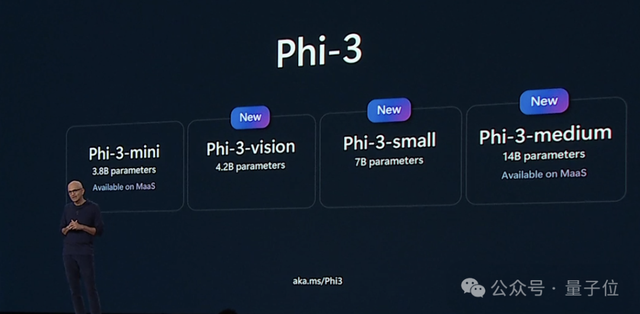

主要有这几个型号:

- Phi-3-mini,38亿参数,支持128k和4k两种上下文。

- Phi-3-small,拥有70亿参数,支持128k和8k两种上下文长度。

- Phi-3-medium,140亿参数,支持128k和4k两种上下文长度。

- Phi-3-vision,42亿参数,支持128k上下文。

- Phi-3-Silica,33亿参数。

其中Phi-3-mini在今年四月份就已经首次亮相过,当时在基准测试中,能力与LIama2相当,收获了不少关注。加上Phi-3-small和Phi-3-medium,他们可以通用Azure Machine learning的模型目录和集合进行访问。

作为最小的模型Phi-3-Silica。从6月份开始,Phi-3-Silica将嵌入到Copilot+PC中面世。它是整个Phi-3型号中最小的一块,只有33亿参数。

微软声称,第一个Token输出速度为每秒650个token,只需损耗1.5瓦功率,换言之不会占用其正常工作和内存。持续运行时,token生成重用了NPU的KV缓存,并将在 CPU 上运行,每秒生成27个token。

Phi-3-vision则是Phi-3家族中的多模态大模型,它可以直接在移动设备上使用。

在Phi-2 模型基础之后,Phi-3-vision能执行日常的视觉推理任务。

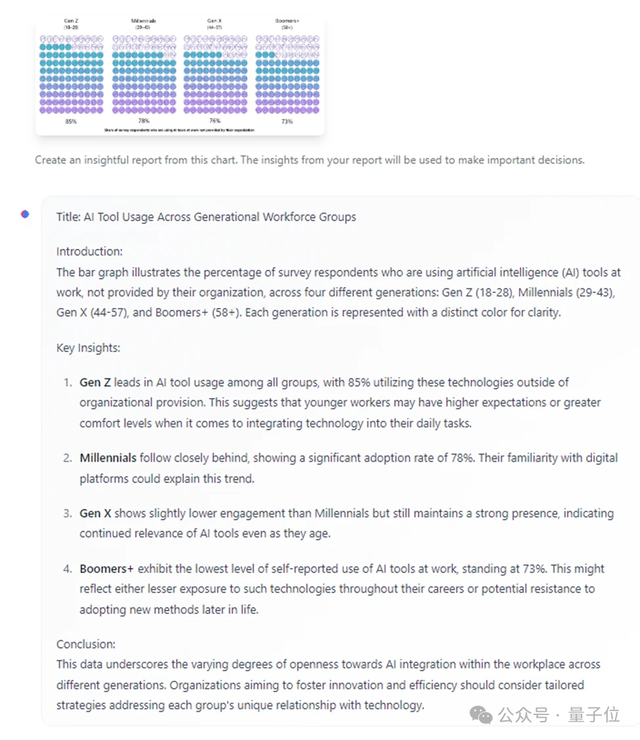

而且专门针对图表进行了优化,能够分析图表中的信息并回答用户提问。

在发布会现场,纳德拉展示了这样的一个DEMO:把一张图表丢给Phi-3-vision,内容是关于不同年龄段的人在工作中使用AI工具的情况。

结果Phi-3-vision准确提取了图中的各组数据,并对不同年龄层的结果进行了比较分析,给出了详尽的报告。

但跟其他大模型不同的是,Phi-3-vision目前只能读取,无法生成。

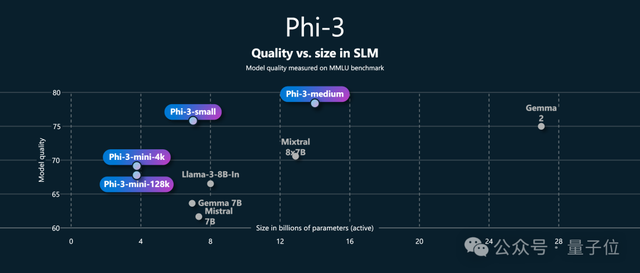

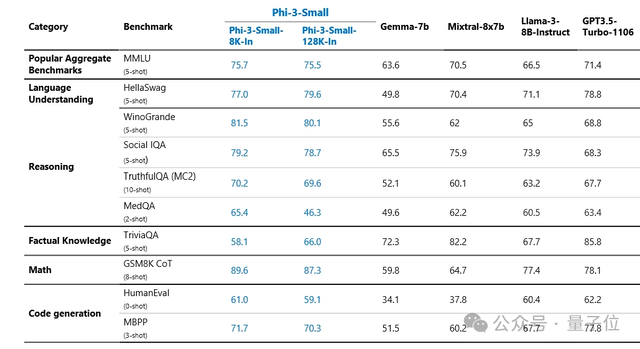

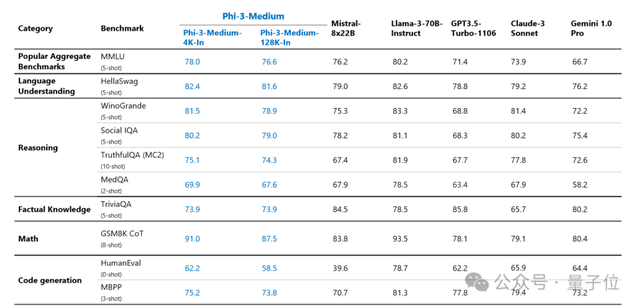

而在测评成绩方面,Small和Medium两个纯文本模型,整体表现都超过了近似规模的其他模型。

甚至不到40亿参数量的Mini,也超过了2倍于自己的Llama3-8B。

具体来看,先是Small在各种语言、推理和数学方面的一系列测试中击败了GPT-3.5-Turbo,不过代码能力小幅落后,知识储备上的差距就比较明显了。

Medium版本对标的则是Claude3-Sonnet和Gemini 1.0 Pro,擅长的任务也和Small类似——语言理解、推理和数学是强项,知识储备是短板。

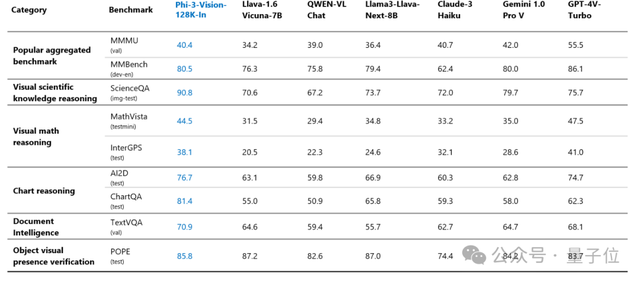

同样,多模态的Vision在语言上也延续了单模版本的优势,在部分视觉任务是还超过了GPT-4v-Turbo。

特别是专门优化过的图表推理任务中,Phi-3-Vision在ChartQA数据集上取得了超过80分的成绩,遥遥领先于GPT-4v。

奥特曼9分钟惊喜亮相

纳德拉仍然表示OpenAI是微软最重要的战略合作伙伴。在发布会进行两小时后,正身处舆论风暴中心的奥特曼亮相了,为整个主题演讲完成闭幕。

不过这次倒是没有跟纳德拉同台,而是跟微软CTO Kevin Scott站到了一起。

在短短9分钟的讲话中,他谈到了OpenAI下一步计划、GPT-4o以及给开发者的建议。

他首先谈到GPT-4o的发布,这是“疯狂的一周”。他称从从来没见过一项技以如此有意义的方式被迅速地采用。

对于最新的寡姐语音风波,奥特曼虽然没有提及,但是特别cue了下他们的语音模式。

随着人工智能速度的提高和成本的下降,OpenAI 已经能够引入语音等新模态;

语音模式对我来说实际上是一个真正的惊喜。

最后,面对在场的开发者们,奥特曼提供了这样一个建议。

他表示,现在正是一个特殊时刻,要充分利用好他,不要等待构建你想要做的事情。这可能是自手机问世以来,甚至自互联网问世以来,我们所见过的最激动人心的时刻。不过,不要指望人工智能会为你做所有的工作;它本身是一种推动力,但它并不会自动打破商业规则。

奥特曼还预告,OpenAI最新最强大模型即将发布——

现在能剧透的似乎很无聊但也很关键,新模态、整体智能,史无前例地强大。

参考链接:

https://build.microsoft.com/en-US/sessions/b49feb31-afcd-4217-a538-d3ca1d171198?source=/schedule

- 英伟达H20不让用?全国产算力推理模型升级,4张华为卡即可部署2025-04-22

- AI应用突围,中小企业的新周期已至2025-04-11

- GPT-4o能拼好乐高吗?首个多步空间推理评测基准:闭源模型领跑2025-04-23

- 飞猪AI意外出圈!邀请码被黄牛倒卖,分分钟搞定机酒预订,堪比专业定制团队2025-04-20