LeCun「超酷」新成果:用自监督姿势打开偏微分方程

有望对PDE通用模型起作用

金磊 发自 凹非寺

量子位 | 公众号 QbitAI

偏微分方程(PDE,Partial Differential Equation),这个在流体动力学、天体物理学等领域的常客,现在有了新求解“姿势”。

深度学习三巨头之一的Yann LeCun,在他自称“很酷”的最新研究中提出——

自监督学习方法用在偏微分方程求解这事上,结果更快更好。

并且LeCun认为,这项工作有望在最终开发偏微分方程的通用基础模型时能起到作用。

对此,网友们在发出“非常有前景”的声音同时,也表示这项工作的开源推动了AI相关工作的发展。

用自监督的方式打开偏微分方程

正如我们刚才提到的,这项研究的主角,即偏微分方程,在众多科学领域中可以说是无处不在。

因为它对于准确预测流体动力学、天体物理学等系统的演变起到了至关重要的作用。

就连北大数学系“韦神”韦东奕的研究方向之一,就是流体力学中的数学问题,其中就包括偏微分方程中的Navier-Stokes方程。

在求解的偏微分方程的道路上,传统的路数是采用数值方法来求解;但它的缺点也逐渐显现出来,那便是计算量大,特别是在有高精度要求的情况下。

后来,随着AI(尤其是深度学习)的发展,为求解偏微分方程开辟了一条又快又好的新路径。

而这也成为了学术界越发关注的领域之一,例如华盛顿大学在2017年提出的PDE-FIND、谷歌AI在2018年提出的数据驱动求解偏微分方程的方法,以及布朗大学在2019年提出的PINN等等。

虽然进步是有目共睹,但Yann LeCun团队在此基础上提出了一个“灵魂一问”:

这些方法有个“通病”:给定方程的神经网络是在同一方程的模拟上训练的,由高精度但相对较慢的数值求解器生成。

如果我们希望从异构数据中学习(例如信息缺失的数据),或从对不同物理系统的实际观测而非纯粹模拟中收集的数据,该怎么办?

为了解决这个问题,Yann LeCun团队从最近成功的自监督学习(SSL)中汲取灵感,将它作为一种工具,以此从大型、无标记的文本和图像数据集中学习丰富表征。

这就相当于从“未标注”关键信息的大型偏微分方程数据集中学习表征,然后将这些表征用于解决数据量有限的下游任务。

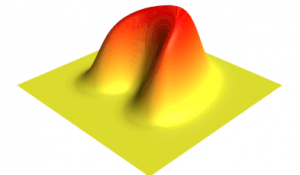

若是以伯格斯方程(Burgers’ Equation)的运动黏度(kinematic viscosity)作为上述“未标注”关键信息,将运动黏度回归作为下游任务,则如下图所示:

(注:运动黏度即流体的动力粘度与同温度下该流体密度ρ之比。)

△在传统的图像数据(上排)和本文提出的PDE(下排)环境下,自监督学习pipeline概览

△在传统的图像数据(上排)和本文提出的PDE(下排)环境下,自监督学习pipeline概览从上图中的pipeline中可以看出,在给定大量未标记数据的情况下,自监督学习使用增强功能来训练网络f(θ),以便从输入图像中生成有用的表征。

给定较小的标注数据集后,这些表征可用作监督学习pipelin的输入,执行预测类标签(图像)或回归运动粘度ν(伯格斯方程)等任务。

这个过程中的重点是,通过自监督学习到的表征函数,在应用于下游任务时不会发生改变。

具体而言,LeCun团队提出了一种学习来自不同偏微分方程数据源表征的通用框架。

他们采用联合嵌入自监督学习范式,其中输入数据通过保留基本信息的增强转换为两个独立的“视图”。

然后,增强的视图通过可学习的编码器传递到下游任务的表示中;自监督学习损失函数由相似性损失和正则化损失组成,以确保不变表示并避免平凡解。

团队还使用方差不变性协方差正则化(VICReg)作为他们的自监督损失函数。

从实验结果上来看,自监督学习方法在解决偏微分方程方面,可以说是优于监督学习方法。

与监督基线相比,经过自监督学习训练的网络将归一化均方误差(NMSE)减少了近三倍。

此外,当给予更大的无标签数据集时,自监督学习方法始终表现更好。

总体而言,实验结果证明了自监督表表征学习在偏微分方程中的有效性。

研究团队

这项研究的团队来自Meta AI、法国古斯塔夫·埃菲尔大学和MIT。

其中,第一作者除了LeCun之外,还包括Meta AI(法国)的Grégoire Mialon。

△左:Yann LeCun;右:Grégoire Mialon

△左:Yann LeCun;右:Grégoire Mialon但这并非LeCun第一次用深度学习方法优化偏微分方程求解问题。

早在2021年3月,他便在推特上发布并开源了关于用深度学习符号求解积分和微分方程的研究。

若是对比传统研究方法,LeCun在与之相关工作的特点可以总结如下:

- 深度学习方法:特别是神经网络,来解决与微分方程相关的问题。传统方法通常依赖于解析或数值方法来求解微分方程。

- 数据驱动学习:强调使用数据驱动学习。他的方法不是仅仅依靠数学公式和假设,而是从大型数据集中学习,以捕获数据中的模式和关系。

- 表征学习:通过从数据中学习通用表示,他的方法旨在捕获方程的底层结构和动力学。与依赖于显式数学公式的传统方法相比,这可以带来更高效和有效的解决方案。

- 自监督学习:这种方法可以帮助学习有意义的表示并发现数据中隐藏的模式,这有利于求解微分方程。

- 对称性的整合:通过将对称性纳入模型,他的方法旨在提高学习表示的泛化和鲁棒性。

若想更深入了解LeCun团队的这项工作,可戳下方链接。

论文地址:

https://huggingface.co/papers/2307.05432

参考链接:

[1]https://twitter.com/ylecun/status/1679489959387090948

[2]https://twitter.com/ylecun/status/1376630942014578694?lang=en

- 刚刚,智谱一口气开源6款模型,200 tokens/秒解锁商用速度之最 | 免费2025-04-15

- 刚刚,商汤发布第六代大模型:6000亿参数多模态MoE,中长视频直接可推理2025-04-10

- 大模型一体机塞进这款游戏卡,价格砍掉一个数量级2025-04-09

- 榨干3000元显卡,跑通千亿级大模型的秘方来了2025-04-14