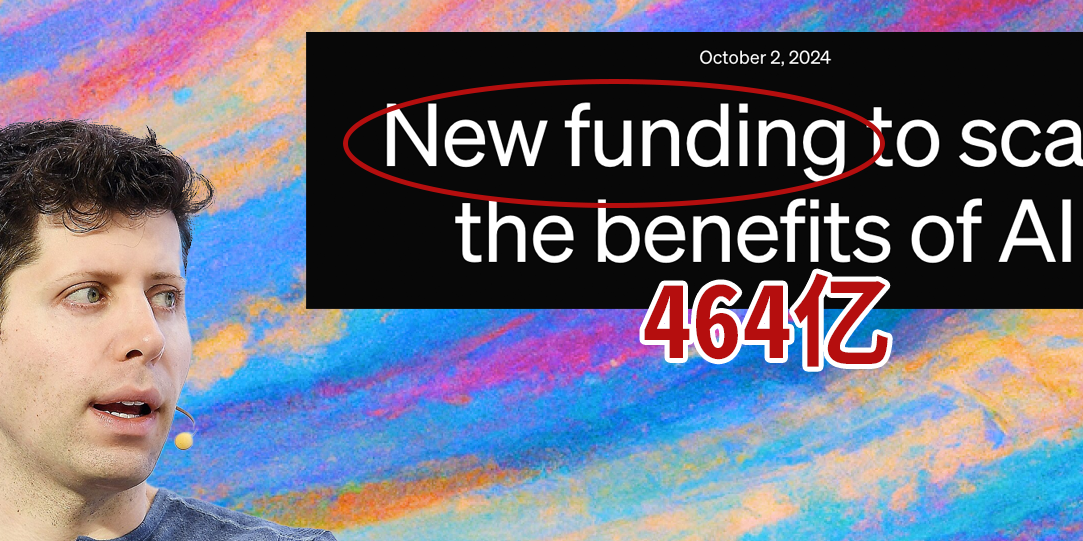

OpenAI提议像管核设施一样管AI!预言十年内AI产出与大公司相当

再次提议建立起国际人工智能监管机构

西风 发自 凹非寺

量子位 | 公众号 QbitAI

OpenAI三位掌舵人联名发文,提议像管核设施一样管AI!

他们预言十年内AI产出将与大公司相当。而超级智能是一把“双刃剑”,必须要受到监管。

近日,OpenAI CEO Sam Altman、总裁Greg Brockman和首席科学家Ilya Sutskever联名发表了一篇“呼吁信”,认为世界需要建立一个国际人工智能监管机构,而且要稳中求快建立起来。

他们解释说:

人工智能的创新速度如此之快,我们不能指望现有的权威机构能够充分控制这项技术。

OpenAI此举受到大量关注,推特上转赞已超3000:

马斯克也来评论底下凑了热闹,“控制很重要”:

有网友认为OpenAI提出这样的举措,阻碍了开放人工智能社区的发展,这看起来是自私的,与OpenAI的名称相违背:

也有网友对OpenAI提出的监管AI表示认同:

很高兴看到这些问题受到更严肃的关注。

其实,在上周美国国会听证会上,Altman就针对AI安全问题提出了三条措施:

- 成立一个新的机构,负责为AI大模型颁发许可,并拥有撤销许可的权力。

- 为AI模型创建一套安全标准,对危险性做评估,包括它们是否能够“自我复制”、“逃出实验室自己行动”。

- 要求独立专家对模型的各种指标做独立审计。

OpenAI此次再次呼吁建立监管机构。

在文章中,OpenAI高层承认人工智能不会自我管理,未来十年内人工智能系统将在很多领域超越专家水平,并且产出能够与当今的最大企业相匹敌。

人工智能的发展已是大势所趋,要想限制它的发展就需要类似全球监视体制的东西出现。

国外媒体TechCrunch认为,虽然OpenAI的提议相当于“也许我们应该做点什么”(也带有一点自夸的倾向),但这“至少是一个起点”。

下面是OpenAI此次发布的文章全文编译:

超级智能的治理

现在是思考超级智能治理的好时机——未来的人工智能系统在能力上将远超通用人工智能(AGI)。

从我们目前的观察来看,可以想象在接下来的十年内,人工智能系统将在大多数领域超越专家水平,其产出能够与当今最大的企业相当。

无论是从潜在的积极影响还是负面影响来说,超级智能都比人类曾经面对的其它技术更加强大。这意味着我们可能会迎来一个极其繁荣的未来。

然而,为了实现这个目标,我们必须有效地管理其中的风险。考虑到潜在的存在主义风险(existential risk),我们不能仅仅采取被动的应对措施。核能就是一个常见的例子,具备类似特性的技术还包括合成生物学。

我们需要降低当前人工智能技术的风险,但对于超级智能,我们需要特别的处理和协调机制。

一个起点

在引导人工智能向良发展的过程中,有许多重要的想法需要我们考虑。

在这里,我们首先对其中的三个想法进行了初步思考:

首先,为了确保超级智能的发展可以在安全的前提下与社会顺利融合,我们需要在前沿的研发工作之间进行一定程度的协调。

实现这一目标可以采取多种方式:全球各政府可以组建一个项目,将现有的许多工作纳入其中;或者我们可以达成一致意见(像下文所建议的,在新组织的支持下),限制人工智能能力的研发增长速度,每年将其保持在一定幅度之内。

当然,我们应该要求各个公司以极高的标准负责任地行事。

其次,最终我们很可能需要类似国际原子能机构(IAEA)这样的机构来管理超级智能。任何达到一定能力(或计算资源等)门槛的项目都应受到国际权威机构的监管。

该机构可以检查系统、要求审计、测试是否符合安全标准,以及限制部署程度和安全级别等。跟踪计算和能源使用情况可能会有很长的路要走,我们需要得到一些使这个想法可以实现的希望。

作为第一步,公司可以自愿同意开始实施这样一个机构未来可能要求的一些准则;第二步,各个国家可以逐步实施。重要的是,这样的一个机构应该专注于降低存在主义风险,而不是处理本应由各个国家解决的问题,比如规定人工智能能够说些什么。

第三,我们需要具备技术能力来确保超级智能的安全性。这是一个开放的研究问题,我们和其他人正在为此付出很多努力。

不在监管范围内的部分

我们认为允许公司和开源项目在明显的能力门槛以下开发模型是非常重要的,无需采取我们所描述的监管措施(包括繁琐的机制,如许可证或审核)。

现今的系统将为世界带来巨大的价值,虽然它们的确存在风险,但它们所带来的风险程度与其它互联网技术相当,而且社会对此的处理方式似乎是恰如其分的。

相比之下,我们关注的系统是那种具有超越目前任何技术的力量。

我们应该注意的是,不要通过对远低于这个标准的技术,应用相似的标准来淡化对它们的关注。

公众参与和潜力

然而,对于最强大系统的治理以及与其相关的部署决策,必须受到公众强有力的监督。

我们认为全世界的人们应该以民主的方式决定AI系统的界限和默认设置。

虽然我们还不知道如何设计这样的机制,但我们计划进行试验来推动。而在界限之内,我们仍然坚持认为个体用户应该对所使用的AI系统的行为拥有很大的控制权。

考虑到其中的风险和困难,我们有必要思考为什么要构建这项技术。

对于OpenAI来说,我们有两个根本原因。

首先,我们相信它将带来一个比我们今天能够想象的更美好的世界(在教育、创意工作和个人生产力等领域,我们已经看到了早期的成果)。

世界面临着许多问题,我们需要更多帮助来解决这些问题,而这项技术可以改善我们的社会。每个人使用这些新工具的创造力肯定会让我们感到惊叹。经济增长和生活质量的提高也将是令人吃惊的。

其次,我们相信阻止超级智能的创建是具有非直观风险和困难的。因为其带来的好处是非常巨大的,建造它的成本每年都在下降,而参与者数量在迅速增加。

它本质上是我们所走的技术道路的一部分,要监管它的发展就需要类似全球监视体制的存在。

但即便如此,也无法保证监管的有效性。

所以,我们必须把它做好。

参考链接:

[1]https://openai.com/blog/governance-of-superintelligence

[2]https://techcrunch.com/2023/05/22/openai-leaders-propose-international-regulatory-body-for-ai/

[3]https://twitter.com/OpenAI/status/1660700692372410368