国产乾元2大模型来了:可编程金融文生图,120亿参数,超对称联手复旦出品

系列模型其中3个将开源

衡宇 发自 凹非寺

量子位 | 公众号 QbitAI

国产大模型队伍正当“百模大战”之际,现在又添一员——

BBT-2,全称BigBang Tansformer-2(乾元2),120亿参数的通用大模型。

以其为基础,项目团队还训练出了代码、金融、文生图等专业模型。

根据官方数据,其中的代码大模型在CSDN的自动编程评测标准上能达到C3,和GPT-3.5处于同一等级“条件自动编程”。

目前,专业的代码问答,已有demo可在线试玩~

据悉,BBT系列模型其中3个即将开源到GitHub、UCloud和官网,开箱可用。

会一并开源的还有近1000亿tokens的通用和金融预训练语料,以及8个中文金融大模型的评测数据集。

而这个项目的背后,是超对称公司和复旦大学知识工场实验室。

术业有专攻的BBT-2系列

BBT-2,是基于GPT Decoder-only架构的大模型,同系列BBT-1模型的2亿参数版本去年已经开源。

此次发布的BBT-2系列模型,包含以下6个:

- BBT-2-12B-Text:120亿参数的中文基础模型

- BBT-2.5-13B-Text:130亿参数的中文+英文双语基础模型

- BBT-2-12B-TC-001-SFT:经过指令微调的代码模型,可以进行对话

- BBT-2-12B-TF-001:在120亿模型上训的金融模型,用于解决金融领域任务

- BBT-2-12B-Image:文生图模型

- BBT-2-12B-Science:科学论文模型

总体看下来,BBT-2系列既有通用大模型,也有术业有专攻的垂域模型。

通用模型

先看通用方面,利用BBT-2,可以进行通用性的人机对话——

比如做一道居家旅行必备家常快手菜:

又或者每天编一个童话故事,讲给不肯睡觉的小朋友:

再或者提纲挈领,写个论文纲要:

专业模型

而专业模型提供的能力就相对聚焦。

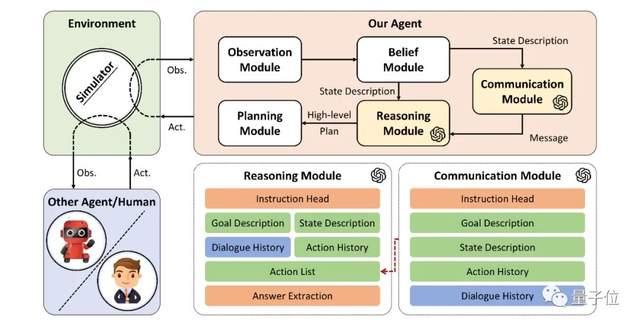

利用BBT-TC,完成代码撰写——这个代码模型,是在百亿基座模型BBT-2-12B-Text后接续训练代码数据集,并通过有监督执行微调(supervised fine-tuing)等技术,实现人类意图对齐。

BBT-TC是微调模型,比其通用大模型推理快不少。因此,代码问答也是本次BBT开放的最主要的能力。

官方公布数据,专业测评中,BBT-TC写代码的能力次于GPT-3.5,但高于Copilot。

△各产品分项得分(150 分制)

实际测评中,BBT-TC会出现大部分代码模型都存在的问题,就是首次回答不完全正确,只有在多次提问后,才会微调出正确答案。

如让它设计一个简化版的推特,并附带一些额外功能。

首次给出的回答,并没有查看推文这部分的代码功能,却擅自增加了显示用户列表的部分。

但再多尝试几次,也会出现一个比较不错的答案。

体验过程中还发现,偶尔BBT-TC还会出现只提供代码实现思路,而非直接生成代码的情况。

也就是说,想要一次性生成能够成功运行的代码,还是需要一些特殊的prompt输入技巧。

(prompt工程师的重要性突然体现)

代码模型外,利用对标BloombergGPT的金融模型BBT-2-Finance,也可以完成金融领域的具体任务。

训练过程中,BBT-2-Finance搜集和爬取了几乎所有公开可以获得的中文金融语料数据。

比如过去20年主流媒体的财经新闻、上市公司公告和财报、金融社交平台用户发帖等。

所以用户可以用它从长篇文本中抓关键信息,撰写摘要:

△ChatGPT和BBT-2-Finance同题对比

和ChatGPT相比,BBT-2-Finance的摘要更简洁,同时也没落下重要信息。

还能针对金融行业对数字的高精度需求,对单位进行换算:

△ChatGPT和BBT-2-Finance同题对比

如上同题对比,ChatGPT就弄错了单位换算,但BBT-2-Finance完成了正确的单位转换。

浅试了一下,表格什么的也能解读且摘取相应文字:

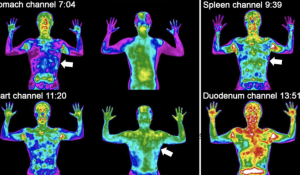

专业领域,除了文字生成,还有个文生图模型BBT-Image。

和一般生成逼真图像的文生图模型不同,BBT-Image专门针对纺织行业,可以生成具有纹理、色彩和设计元素的纺织品团。

可以对比一下它和Stable Diffusion的生成效果。

△prompt:热带花卉芙蓉花,热带叶子,水彩效果图案,黑色背景,无缝图,循环图

△prompt:五颜六色的水母图案,细节清晰,无缝图,循环图

至于在科研论文上训练构建的BBT-Sicence,官方称可以应用在物理、化学、生物、数学领域,它能提供的能力主要有三方面:

- 一是快速精准的知识检索;

- 二是针对所研究领域的前沿问题提供新的ideas;

- 三是利用多学科知识训练出的能力提供跨学科的建议。

还要提一句,整个BBT系列中的3个模型即将开源,分别是金融模型BBT-1-1B、基础模型BBT-2-12B-Text、基础模型BBT-2.5-13B-Text。

背后团队

一系列操作的幕后玩家,是超对称技术公司和复旦大学知识工场实验室。

超对称技术公司在去年5月,发布了大模型BigBang Tansformer(乾元)的第一版BBT-1,在中文金融语料上训练而成的10亿参数模型。

复旦大学知识工场实验室,源于复旦图数据管理实验室(GDM@FUDAN),由教授肖仰华领衔。

整个过程,超对称公司主导预训练部分,指令微调和评测工作则联合复旦大学知识工场实验室完成。

据悉,有了系列模型后,背后团队也开始致力于对科学大模型进行评测。

超对称合作复旦、上海交大、浙大、南航、中山、北师大等多所大学,号召全球一线科研人员共同构建科研问题评测数据集ResearchQA,覆盖数学、物理、化学、生物、地理地质、计算机和电子工程等前沿科研领域。

ResearchQA提交邮箱:researchqa@susymmetry.com

BBT-2地址:https://www.ssymmetry.com/

- 心影随形创始人刘斌新:做不跟用户抢时间的AI产品丨中国AIGC产业峰会2025-04-22

- 直观即时绘制3D模型,可添加文本提示,VAST又开源了2025-04-21

- LIama 4发布重夺开源第一!DeepSeek同等代码能力但参数减一半,一张H100就能跑,还有两万亿参数超大杯2025-04-06

- 超九成年轻人工作学习离不开AI,人均还有1.8个AI朋友丨Soul《2025 Z世代AI使用报告》2025-04-06