微软亚研院:Language Is Not All You Need

给语言大模型加点料,梗图IQ测试都能秒答

鱼羊 发自 凹非寺

量子位 | 公众号 QbitAI

还记得这张把谷歌AI搞得团团转的经典梗图吗?

现在,微软亚研院的新AI可算是把它研究明白了。

拿着这张图问它图里有啥,它会回答:我看着像鸭子。

但如果你试图跟它battle,它就会改口:看上去更像兔子。并且还解释得条条是道:

图里有兔子耳朵。

是不是有点能看得懂图的ChatGPT内味儿了?

这个新AI名叫Kosmos-1,谐音Cosmos(宇宙)。AI如其名,本事确实不小:图文理解、文本生成、OCR、对话QA都不在话下。

甚至连瑞文智商测试题都hold住了。

而具备如此能力的关键,就写在论文的标题里:Language is not all you need。

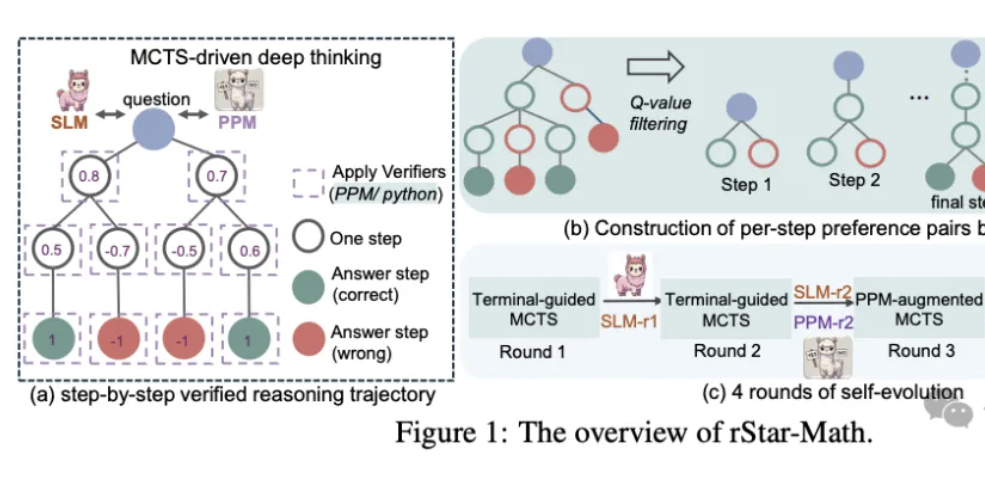

多模态大语言模型

简单来说,Kosmos-1是一种把视觉和大语言模型结合起来的多模态大语言模型。

在感知图片、文字等不同模态输入的同时,Kosmos-1还能够根据人类给出的指令,以自回归的方式,学习上下文并生成回答。

研究人员表示,在多模态语料库上从头训练,不经过微调,这个AI就能在语言理解、生成、图像理解、OCR、多模态对话等多种任务上有出色表现。

比如甩出一张猫猫图,问它这照片好玩在哪里,Kosmos-1就能给你分析:猫猫戴上了一个微笑面具,看上去就像在笑。

又比如让它看一眼MSRA用来高效训练大模型的TorchScale工具包的主页,Kosmos-1也能快速get这个库是用来干啥的。

Kosmos-1还能理解图像上下文。发一张食物的照片给它,这个AI不仅能回答你这是什么,还能在你追问如何烹饪时,给出食谱和烹调小建议。

Kosmos-1的骨干网络,是一个基于Transformer的因果语言模型。Transformer解码器作为通用接口,用于多模态输入。

用于训练的数据来自多模态语料库,包括单模态数据(如文本)、跨模态配对数据(图像-文本对)和交错的多模态数据。

值得一提的是,虽说“Language is not all you need”,但为了让Kosmos-1更能读懂人类的指示,在训练时,研究人员还是专门对其进行了仅使用语言数据的指令调整。

具体而言,就是用(指令,输入,输出)格式的指令数据继续训练模型。

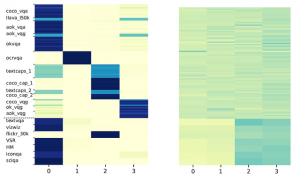

实验结果

研究人员在5大类共10个任务中,测试了Kosmos-1的效果,包括:

- 语言任务:语言理解、语言生成、无OCR文本分类

- 跨模态迁移:常识推理

- 非语言推理:IQ测试(瑞文递进矩阵)

- 感知-语言任务:图像说明、视觉QA、网页QA

- 视觉任务:零样本图像分类、带描述的零样本图像分类

从实验结果上来看,Kosmos-1基本都hold住了。

零样本图像说明:

零样本视觉QA:

无OCR文本理解:

研究人员还提到,Kosmos-1是第一个能完成零样本瑞文智商测试的AI。

不过,跟成年人类的平均水平相比,AI的“智商”还差得有点远。随机选择的正确率为17%,而Kosmos-1经过指令调教之后,准确率为26%。

研究人员认为:

但Kosmos-1证明了多模态大模型有潜力将感知和语言结合起来,进行零样本的非语言推理。

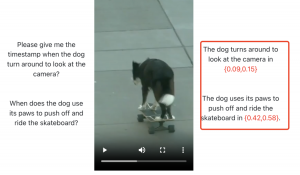

另外,研究人员还展示了Kosmos-1处理复杂问答和推理任务的过程。关键在于多模态思维链提示。

研究人员将感知-语言任务分解为两个步骤。第一步,给定一个图像,引导模型对图像进行分析。

第二步,把模型子集分析出来的结果再喂给它,并给出任务提示,以生成最后的答案。

这项新研究来自MSRA的韦福如团队。韦福如是微软亚洲研究院自然语言计算研究组主管研究员。

三位一作分别是Shaohan Huang、董力和Wenhui Wang。

论文地址:

https://arxiv.org/abs/2302.14045

— 完 —

- 粉笔CTO:大模型打破教育「不可能三角」,因材施教真正成为可能|中国AIGC产业峰会2025-04-18

- GPT-4.1淘汰了4.5!全系列百万上下文,主打一个性价比2025-04-15

- SOTA自动绑骨开源框架来了!3D版DeepSeek开源月大礼包持续开箱ing2025-04-11

- 语音界Deepseek!百度最新跨模态端到端语音交互,成本最高降90%2025-04-02