大脑“拖延症”让你直呼“眼瞎”:加工视觉信息有15秒延迟 | Science子刊

你根本看不到实时画面

梦晨 发自 凹非寺

量子位 | 公众号 QbitAI

你知道变化盲视吗?说的是环境明明出现大的变化,人却很难察觉到。

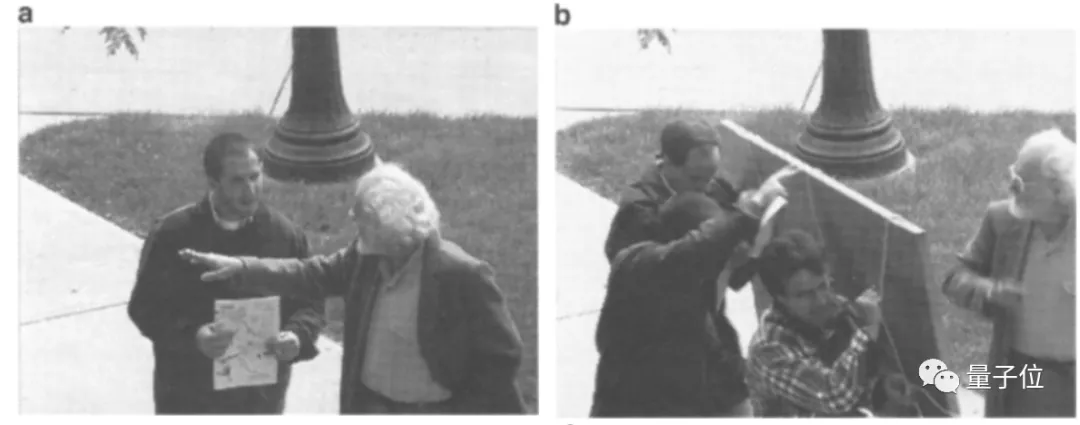

变化大到找你问路的陌生人偷偷换了一个,你都没感觉,对话还能继续下去。

实验很简单,先让A随机找人问路,这时有人举着广告牌喊着“借过借过”把两人隔开。

之后A举着广告牌溜了,换成B留下接着问,两个人长相、身高、穿着、声音都不一样。

无辜路人却毫无察觉,还会继续给B指路。

这个实验最早出现在1998年,后来又被无数电视节目、网络视频复刻过,只有少数人能感觉出不对劲。

(搜“变化盲视”或“Change Blindness”就能找到很多)

以往对这个诡异的现象,科学家都是从注意力分配等方面找原因。

现在,一项发表在Science子刊的新研究,从认知神经科学的角度提出了全新解释。

原来是从大脑加工视觉信息的底层机制上就出了问题。

研究者设计了新的实验,分析结果后提出:

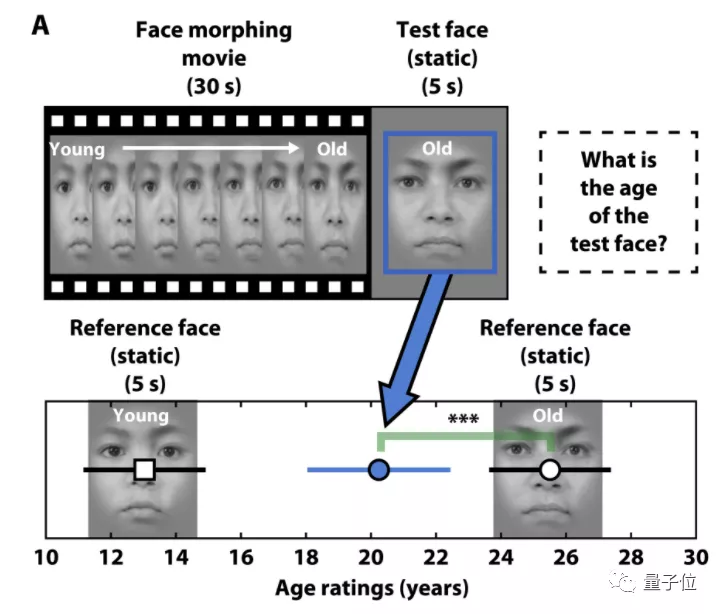

大脑处理视觉信息有延迟,而是把最近一段时间看到的画面作平均混合后才更新一次。

刷新的时间大概在15秒。

大脑在偷懒?

为了排除注意力不集中的影响,这次实验方法不再让环境突然变化,而是使用了连续变化的图像。

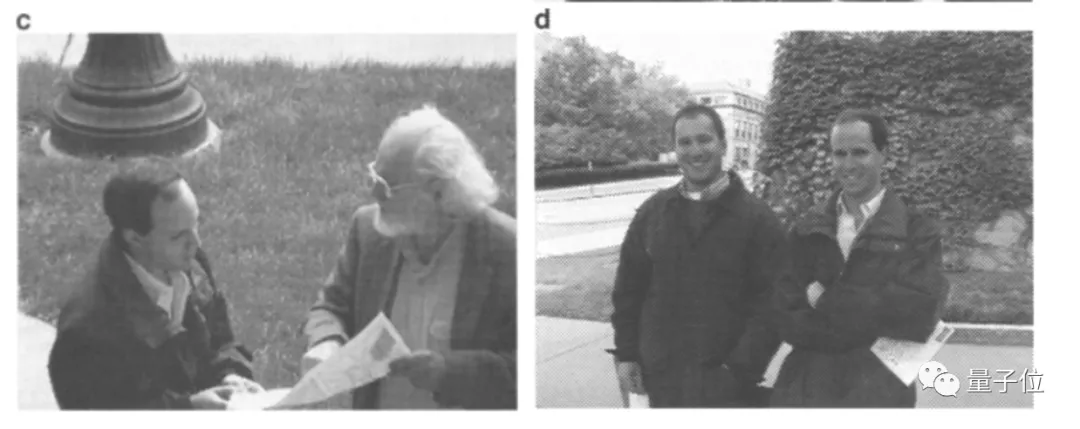

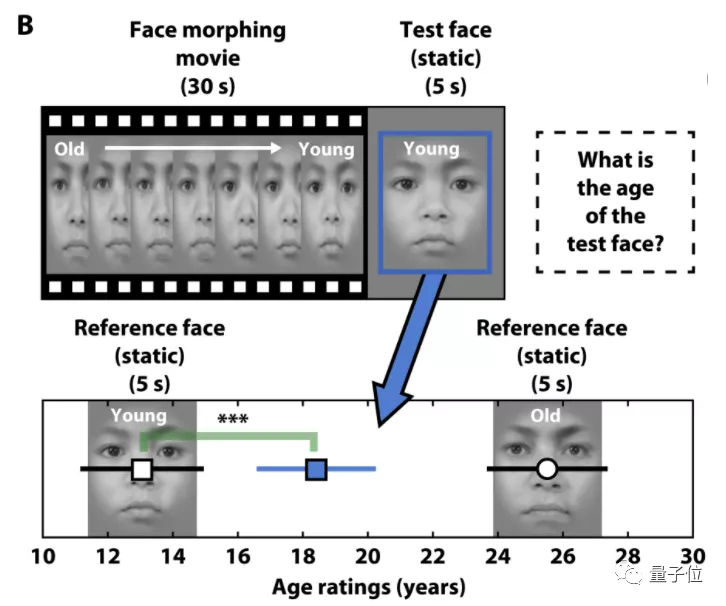

他们找来两组人,分别回答一张年轻的脸和一张年老的脸是多少岁。

再找第三组人观看这张脸逐渐变老的30秒视频,问他们年龄增加了多少。

结果47名观看了视频的人会显著低估年龄的变化,平均低估了5岁左右。

继续验证,把视频倒过来,让第四组人看从老变年轻,结果这些人对变化同样有低估。

为了让实验更精确,研究人员后续还做了更多实验排除其他影响因素。

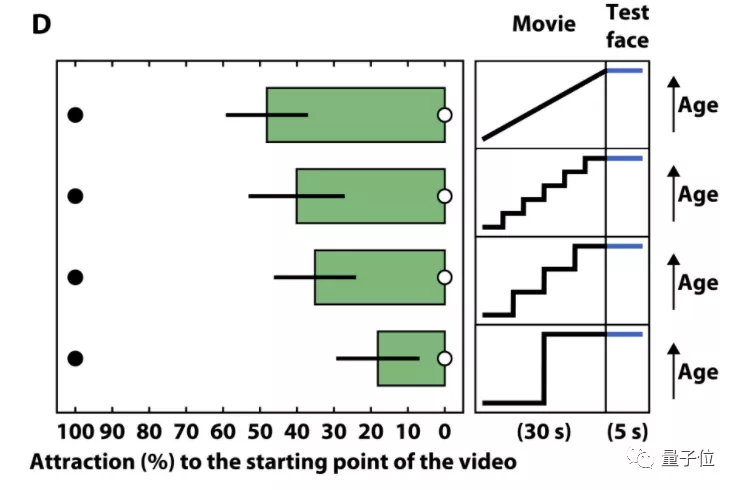

比如改变视频中面孔年龄变化的梯度,从逐渐变化到突然变化。结论是变化的梯度越大,参与者受到视频开头的影响越小。

这进一步说明了参与者对面孔年龄的判断依据不仅与开头图像有关,而是整个视频都有影响。

另外还有给视频加上随机噪声、把年龄变化换成性别变化等等,总共12组对比实验,这里不再一一展示。

总之,研究根据所有实验结果计算得出:

人们看不到最新的实时图像,而是最近15秒左右所有信息做平滑处理的结果。

论文作者Mauro Manassi和David Whitney,来自UC伯克利。

他们认为这种大脑这种机制算是一种“偷懒”,或拖延症,不过有两点好处。

一个是可以节能。

实时处理每一帧视觉信息需要不停调动大量的视觉神经元,消耗太大。

另一个是带来稳定的认知。

如果实时更新图像,人类会感觉世界过于混乱和不稳定。

光影、透视的轻微变化都会让人无法确定眼前物体与之前是否为同一个,根本没法正常生活。

但是也有坏处

这种延迟和模糊机制在大部分日常生活场景中都有积极作用,但当需要绝对精确的视觉信息时也会产生问题。

同一个团队的另一项研究发现,当放射科医生检查X光片时,不仅基于当前片子做判断,还受之前片子的影响。

由此产生的错误率在3%-5%左右,会对患者造成误诊,影响治疗甚至危及生命。

不知道这是否意味着,把这些要求精确性的任务交给没有延迟机制的AI来做,会更有优势?

最后,可以来试试你自己会不会变化盲视,看看用多长时间能找出这张图片前后的不同。

论文地址

https://www.science.org/doi/10.1126/sciadv.abk2480

参考链接:

[1]https://theconversation.com/everything-we-see-is-a-mash-up-of-the-brains-last-15-seconds-of-visual-information-175577

[2]https://link.springer.com/article/10.1186/s41235-021-00331-z

- 百度阮瑜:大模型应用落地正从简单高容错向复杂低容错场景延伸|中国AIGC产业峰会2025-04-24

- 全球首个无限时长视频生成!新扩散模型引爆万亿市场,电影级理解,全面开源2025-04-21

- 教育信创到底怎么选?能做到”无感切换”的只有C862025-04-21

- 清华张亚勤:10年后,机器人将可能比人都多2025-04-21