港科大硕士ICCV论文被指抄袭,导师不知情,二作震惊求撤稿,网友:其余12篇顶会都查查

原论文作者:核心思路照搬,已找到14处雷同

“几乎一模一样!”

最近,顶会ICCV接收的一篇论文被指控抄袭顶会ICML上的一篇!

而“抄袭者”是两位来自中国高校的硕博生。

一经爆料,就迅速在知乎、Reddit等平台上引发了不小的关注。

而爆料人正是原论文的作者,他专门发表了一篇博客指出抄袭论文在核心思路、实验和图表等地方的14处雷同。

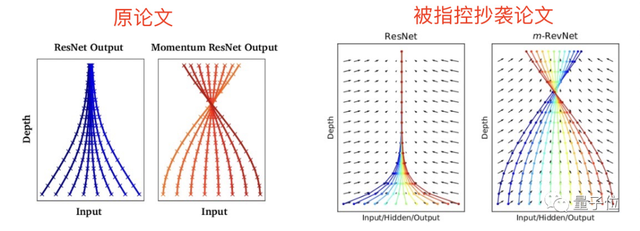

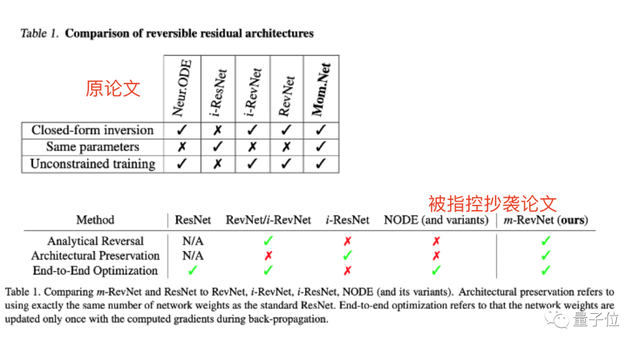

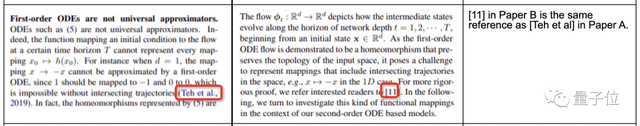

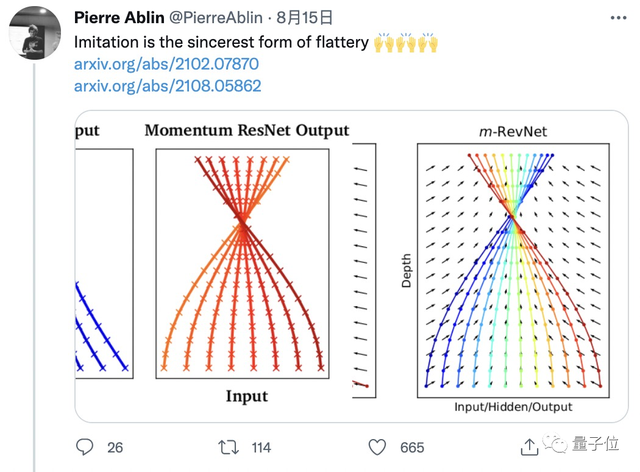

就比如单看下面这两组图表:

有啥不一样??

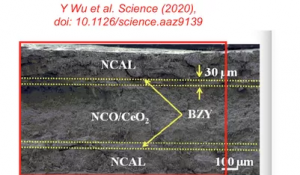

第一组里的“抄袭图”不过是加了矢量场、改了颜色;

第二组里的每行表头意思一样,只不过换了个说法,列头也一样,只不过调了顺序。

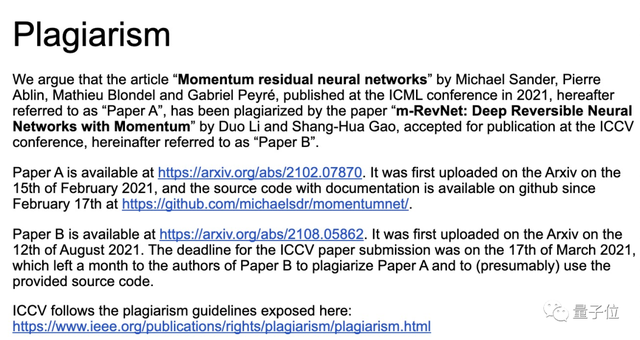

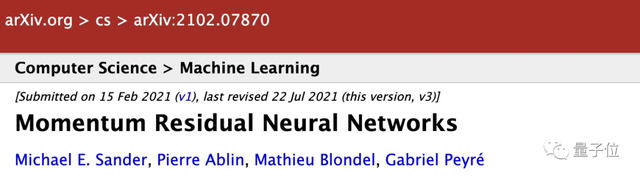

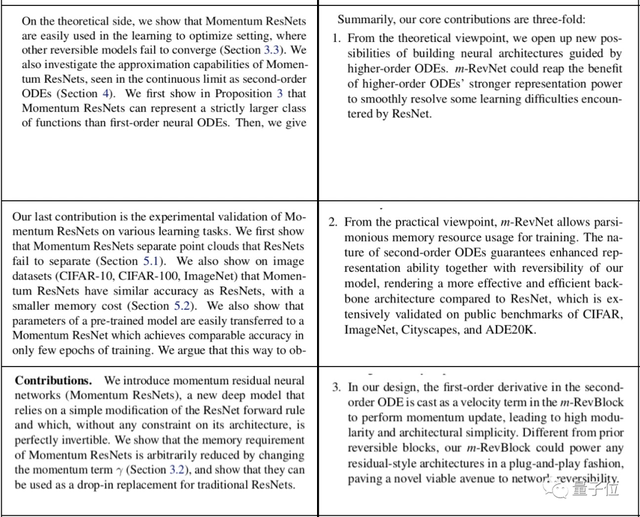

再看原论文的题目,叫做《Momentum Residual Neural Networks》,于今年2月15日首次上传到arXiv,2月17日起在GiHub上提供源码。

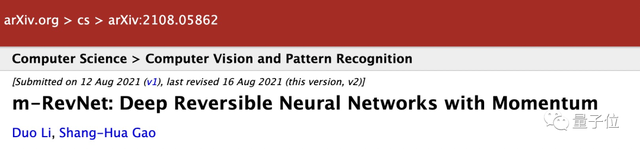

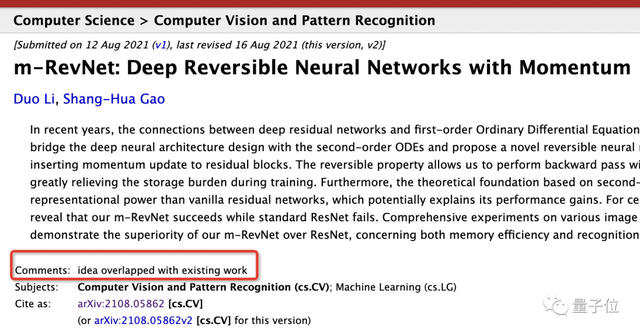

被指控抄袭论文题目叫做《m-RevNet: Deep Reversible Neural Networks with Momentum》,于8月12日上传到arXiv。

而其所被接收的顶会ICCV 2021的截止提交时间为3月17号。

指控作者表示,这给抄袭者留下了一个月的时间来copy代码和论文。

一篇顶会论文14处雷同

原论文是一篇关于通过添加动量项(momentum term)来改变ResNets网络的forward规则,从而达到使用可逆体系结构来规避训练ResNets造成的内存消耗的研究。

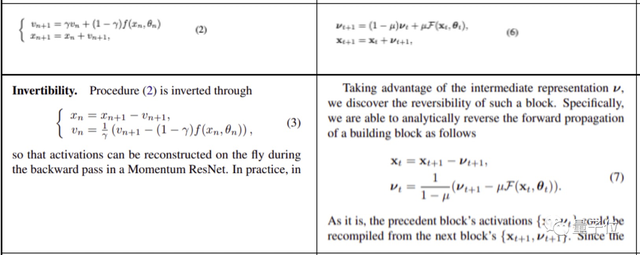

原作者表示:两篇论文用到的实现方法一模一样,都是将残次网络的前向方程替换为动量方程。

而两者对该方法的好处的讨论也类似:可逆性减少内存负载,ODE中的动量增加网络的表达能力。

具体来说,除了开头提到的两处图表,还有以下12点雷同之处(左边为原论文,右边为被指控抄袭的论文):

- 选择了完全相同的初始数据集,都用了四个嵌套环(nested rings)(作者表示此为创举,此前研究还没有用4个的情况)

- 核心公式雷同,添加了非常轻微的改动

- 引用的文献相同

- 对原论文附录公式进行复制粘贴,所用的微分方程完全相同

- Contributions写的也一样,只不过调换了顺序

……

剩下的几处就不一一列举了(可在文末链接[3]查看所有)。

总之相似之处如此之多,也没有看到引用,以至于原作者认为它们不能归因于偶然,完全可以证明抄袭。

他已向ICCV 2021委员会发送通知,最终调查结果还没出来,但可以看到被指控抄袭的这篇论文已在arXiv被标记为“和已有研究重复”。

被指控方回应

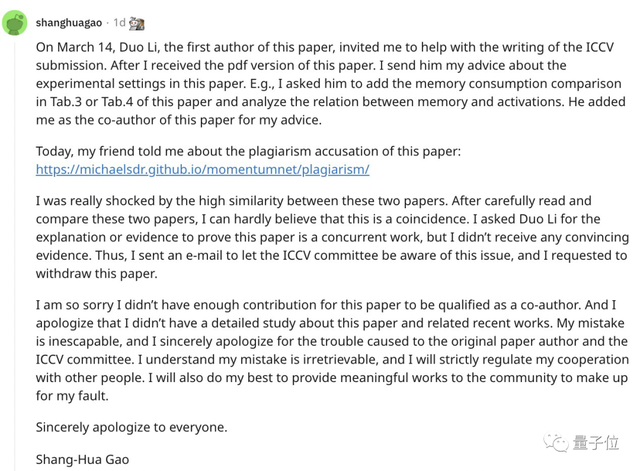

而在被指控抄袭者这边,论文二作高尚华(南开大学博士生)在知乎和外网(Reddit)上先后作了回应:

一作李铎邀请我帮他修改他的ICCV投稿。我收到他发给我的文章pdf文档后,提出了关于文章写作和实验修改的建议(部分实验修改建议李铎并未采纳)。

受到抄袭指控的时候他也很震惊,向李铎求证,但对方表示无法提供,他因此也无法相信这不是抄袭。

所以除了道歉,他随后就向ICCV PC反应了相关情况,并要求撤稿。

我在这个事件中承认并深刻检讨我对于文章合作方面的不严谨,我对自己在没有对这项工作有充分贡献但成为作者感到十分抱歉和羞愧。

撤稿邮件:

“始作俑者”李铎的导师,陈启峰也表示:

该论文属于一作李铎在疫情期间不在香港所作的工作,并没有参与,也没有作为共同作者。但作为导师的我有不可推卸的督导不严的责任。

并宣称正在深入调查该学生包括其他论文在内的工作,近日会公布相关处理措施。

一天多之后才回应的是李铎本人,他向原论文作者以及这篇论文的二作和导师道歉:

我已经进行了深刻的自我反省和检讨,对于在此事件中受到伤害的Paper A的作者们,以及Paper B的合作者表示衷心的抱歉(高尚华同学仅参与到paper revision,对于细节不甚了解),同时对于给两位导师引起的不必要的麻烦和误解表示诚挚的歉意。

并对雷同之处进行了一一“说明”:

但网友已经不买账。

据个人主页,他是清华自动化专业2019届毕业生,还是ICCV、 CVPR、 ICML、NeurIPS、ICLR、AAAI审稿人,现在是香港科技大学二年级硕士生。

网友质疑:抄袭惯犯?

举证者在推特上的曝光是简单写了一句“Imitation is the sincerest form of flattery”(模仿是最真诚的奉承),看起来像在尽量保持风度。

而网友们质疑的有两点:

一是李铎应该不是第一次这么做,他主页上挂的12篇CVPR/ECCV/ICCV的论文都是怎么来的让人怀疑(尤其7篇还是一作);

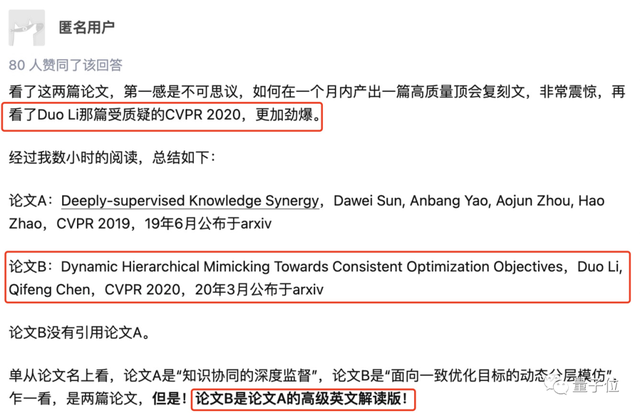

针对这一点,国内外都早已有人扒出了他涉嫌洗稿/抄袭的其他顶会论文:

- Dynamic Hierarchical Mimicking Towards Consistent Optimization Objectives (CVPR 2020)

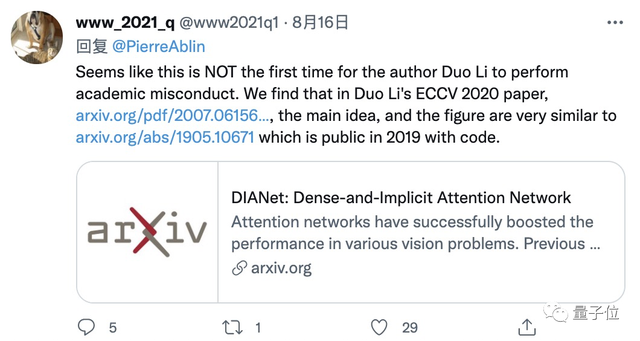

- Deep Reinforced Attention Learning for Quality-Aware Visual Recognition(ECCV 2020)

还有他发表在CVPR 2021上的那篇Involution,也被很多人指出嫌疑。

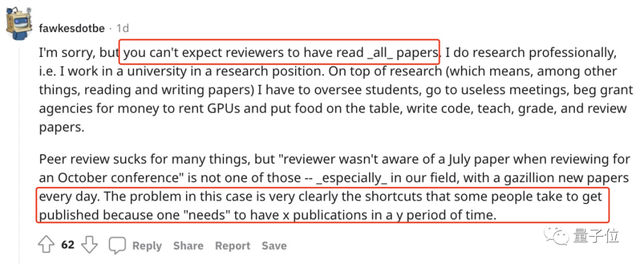

大家质疑的另一点是到底是谁过审的这种论文。

不过有观点认为这事不能归咎于同行评审,因为他们不可能在短时间内读过所有最新论文,所以这分明还是发稿人在“钻空子”。

至于为什么要如此“频频”铤而走险,很多人不得其解。

接下来就看ICCV官方和涉事学校如何处理吧。

参考链接:

[1]https://www.reddit.com/r/MachineLearning/comments/p59pzp/d_imitation_is_the_sincerest_form_of_flattery/

[2]https://twitter.com/PierreAblin/status/1426899071495819265

[3]https://michaelsdr.github.io/momentumnet/plagiarism/

[4]https://www.zhihu.com/question/480075870

- 北大开源最强aiXcoder-7B代码大模型!聚焦真实开发场景,专为企业私有部署设计2024-04-09

- 刚刚,图灵奖揭晓!史上首位数学和计算机最高奖“双料王”出现了2024-04-10

- 8.3K Stars!《多模态大语言模型综述》重大升级2024-04-10

- 谷歌最强大模型免费开放了!长音频理解功能独一份,100万上下文敞开用2024-04-10