1种策略就能控制多类模型,华人大二学生提出RL泛化方法,LeCun认可转发 | ICML 2020

这个智能体模型不仅可以模拟人的动作,特殊形态的机器人也不在话下~

萧箫 发自 凹非寺

量子位 报道 | 公众号 QbitAI

如果给你几十甚至几百种模型,让你用1种策略对它们进行训练,怎么做?

上图中的这些智能体模型,不仅仅模拟「人」的动作,有些还代表着「四足动物」、「两足动物」,亦或者是特殊形态的「机器人」的行为。

智能体,能进行自主活动的硬件或软件实体。例如,可以是某种智能机器人。

而所有的这些智能体,都能通过1种策略来表达。

通过强化学习,模型中分散的肢体间也能进行消息传递,甚至能表示出训练中没有发现的模型。

论文在Reddit上po出后,一天之内就获得了近900热度。

与此同时,Twitter上也获得了Yann LeCun的转发。

对于强化学习,LeCun曾经给出过比喻:「如果智能是蛋糕,无监督学习就是那块蛋糕,有监督学习是糖衣,而强化学习则是糖衣上的樱桃。」

但现在看来,LeCun似乎对于这份强化学习的研究非常感兴趣。

毕竟,就个体差异而言,仅通过1个策略达到控制多种不同形状的智能体,需要模型具有很好的泛化能力。

来看看研究者们是怎么实现这个策略的。

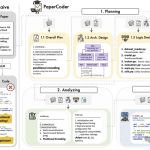

整体架构原理

首先,将所有智能体放在一起进行训练。

不同的是,相比于对模型架构进行整体训练,他们将智能体拆解成多个肢体部分,分别进行训练。

这个策略中权重(πθ)被智能体中的所有肢体部分共享,也就是说,不仅对于其中一个肢体是这样,其他智能体的肢体也是如此。

为了确保肢体协调,各肢体间可以进行信息传递。

每个肢体之间都有自己的位置,传递信息的顺序基本都遵循由下至上、再由上至下。

最后,动作会在向下的信息传递中被预测。

整体模型结构如下图所示。

在这期间,图左的智能体控制器和图中间拥有共同参数的沟通模块会被放在一起训练,学习如何将信息传递给右边的中心控制器。

这样的策略,被称为模块化共享策略SMP(Shared Modular Policies)。

研究者们希望能了解到通过SMP,模型进行信息传递的效果。

下图从左至右分别展示了随着训练次数的增加,某一模型从上至下进行信息传递的信息量。

可以看见,模型在运动过程中的信息量会有峰值,为保持模型平衡进行大量信息传递。

所以,为了保持平衡,模型在运动过程中将会进行大量信息传递,尤其是在「双腿」迈开时。

而肢体间的这些信息传递也是这种学习策略得以泛化模型的关键。

训练效果

从训练结果来看,即使是有着相似结构的模型,在步态上也能展示出几乎完全不一样的效果。

如图所示,图中红色圈内的三个模型虽然结构相似,但运动的步态却几乎完全不同。

不仅如此,训练过程中还有意外收获。

研究者们发现在训练过程中,这种学习策略还生成了一些以前完全没见过的智能体模型,这些模型可能同时有好几条腿、或是非常重的手臂。

如果在测试时适当地调整模型结构,这种策略也能很好地将它们保持平衡。

但目前也有一点小问题,如果将某一部分肢体的肌肉放大到超乎常理、或是将腿部完全去掉,可能会导致模型失去平衡。

无论如何,这个学习策略所展示出来的模型泛化能力已经足够引人惊叹。

有网友猜测,兴许这是图神经网络的一项应用。

这真不错!信息通过肌肉架构传递,且拥有共享权重?听起来GNN能完成得很好。

也有网友表示,这也许是将强化学习应用到电子游戏和机器人之外的更广泛领域的一个契机。

如果我们可以将强化学习应用到电子游戏和机器人以外的方向,这会是一次很有意思的研究。

华人一作

这篇论文的第一作者Wenlong Huang,目前在加州大学伯克利分校就读大二,学习计算机视觉。

高中时,他曾与加州大学圣迭戈分校的Zhuowen Tu教授共同研究3D生成模型,目前感兴趣的研究方向是强化学习、机器人和计算机视觉。

除此之外,他的业余爱好也很广泛,不仅喜欢拉小提琴,也钻研摄影方向。

论文链接:https://arxiv.org/abs/2007.04976

参考链接:https://www.reddit.com/r/MachineLearning/comments/hpajb2/r_one_policy_to_control_them_all_shared_modular/

- 人人可用的超级智能体!100+MCP工具随便选,爬虫小红书效果惊艳2025-04-29

- 当购物用上大模型!阿里妈妈首发世界知识大模型,破解推荐难题2025-05-01

- OceanBase全员信:全面拥抱AI,打造AI时代的数据底座2025-04-27

- 网易有道张艺:AI教育的规模化落地,以C端应用反推大模型发展2025-04-27